Point chaud dans les data center : causes et effets

Accueil » Data Center » Point chaud dans les data center : causes et effets

EOLIOS prend soin de votre data center :

- Analyse des risques de surchauffes

- Recherche de points chauds

- Réalisation des jumeaux numériques

- Optimisation de la température de souffage

- Etude de l'impact des masques aérauliques

- Dimensionnement des systèmes climatiques

- Etude transitoire en shutdow

- Réalisation des jumeaux numériques

- Une équipe passionnée

Poursuivre la navigation :

Nos dernières actualités :

Nos projets :

Nos domaines d'intervention :

Dossiers techniques :

Vous avez besoin d'une expertise ?

Quelles températures dans un data center ?

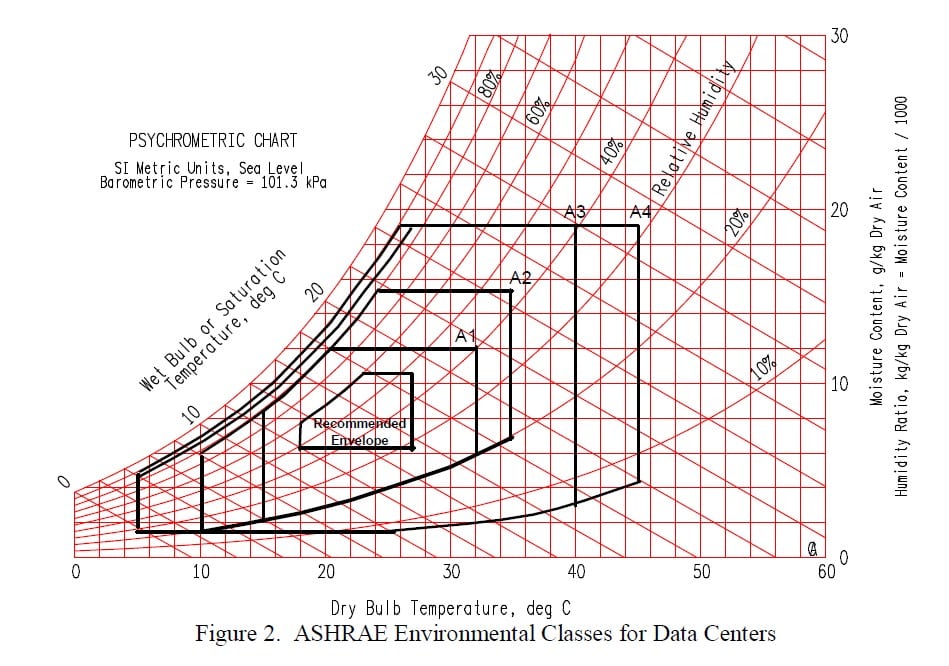

Norme Ashrae

La norme Ashrae (American Society of Heating, Refrigerating and Air-Conditioning Engineers) sur la température des data centers est une recommandation standardisée pour la gestion de la température dans ces infrastructures. Cette norme est régulièrement mise à jour pour tenir compte des avancées technologiques et des meilleures pratiques de l’industrie.

La norme Ashrae recommande une plage de température pour les data centers, plutôt qu’une température spécifique. La plage typique recommandée est comprise entre 18°C et 27°C (64°F et 81°F). Cela permet une certaine flexibilité pour les opérateurs de data centers, qui peuvent ajuster la température en fonction de leurs besoins spécifiques.

L’un des principaux objectifs de cette norme est d’optimiser l’efficacité énergétique des data centers tout en maintenant des conditions appropriées pour le fonctionnement des équipements. Des températures trop élevées peuvent entraîner une surchauffe des composants et une défaillance des systèmes, tandis que des températures trop basses peuvent augmenter la consommation d’énergie du système de refroidissement.

Origine des points chauds dans un data center

Explication des principaux phénomènes thermo aéraulique

Les points chauds dans un centre de données sont définis par l’ ASHRAE TC 9.9 comme des zones où l’air entrant dans les serveurs, les systèmes de stockage, les routeurs ou tout autre équipement électronique sera supérieur à 27 °C. La zone arrière des rack et les zones dans les allées chaudes ne sont pas considérées comme des points chauds. Les points chauds peuvent réduire la fiabilité et endommager les équipements électroniques en raison de l’incapacité de dissiper la chaleur générée.

Les fabricants de serveurs et de matériel informatique peuvent justifier le refus du service de garantie en raison de la violation des termes du contrat de service par la présence de zones chaudes.

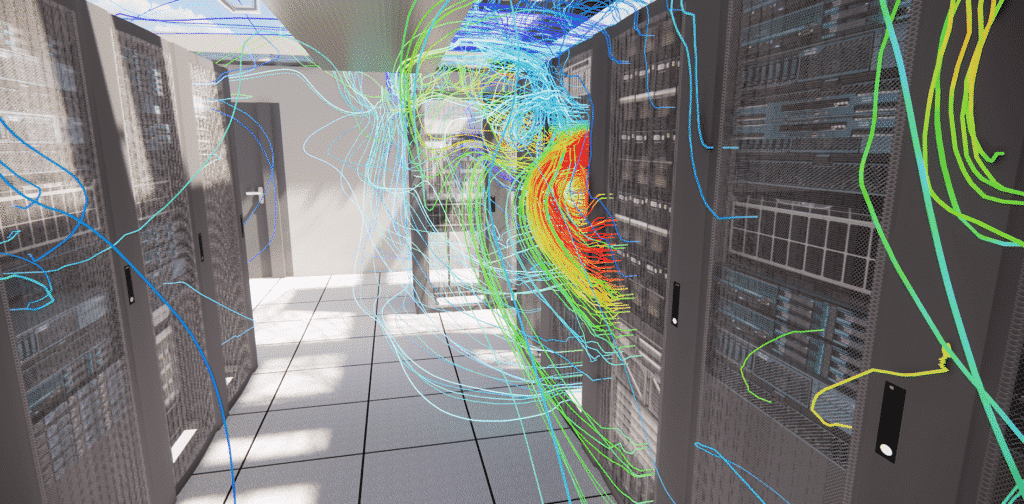

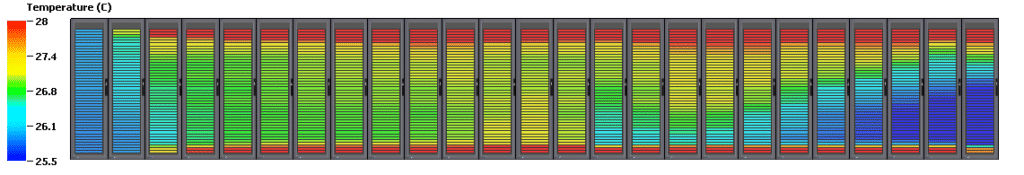

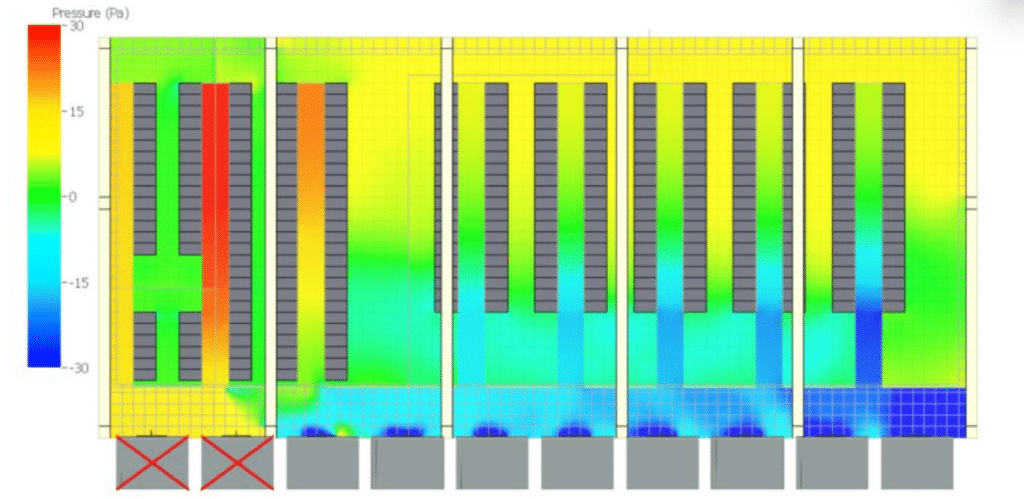

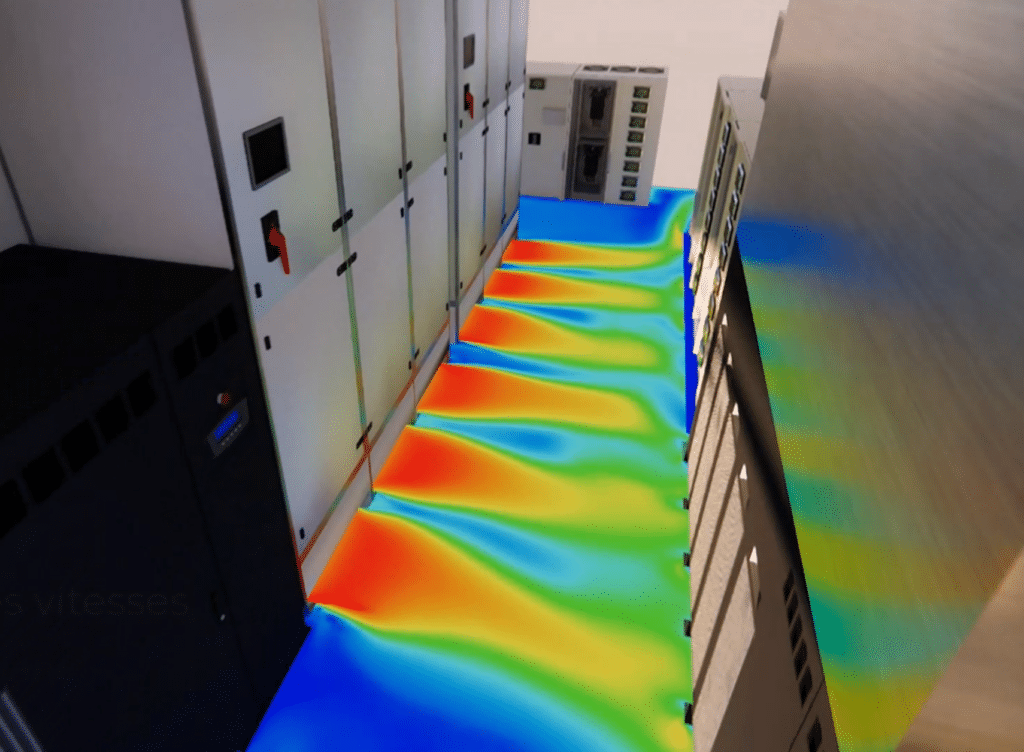

Simulation CFD dun data center en surchauffe généralisé (absence de cloisonnement)

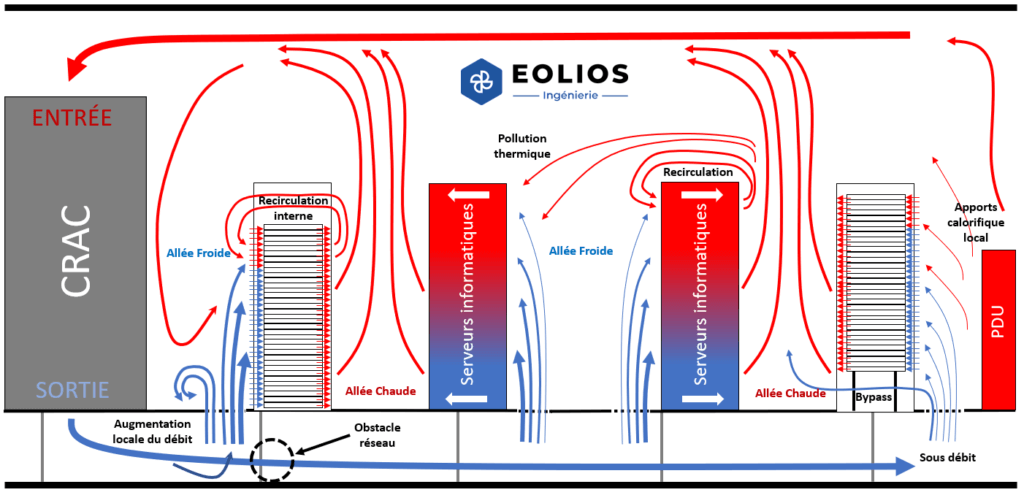

Quelles entrées d’air parasites peut-il y avoir dans un centre de données ?

Il s’agit généralement d’entrées de câbles non scellées ou d’entrées de conduits de câbles de la salle informatique, les fentes de conduits d’air, fentes au bas des supports porteurs ou simplement de trous dans les murs ou de portes. Dans le cas du plancher surélevé lui-même, il peut exister des ouvertures pour l’entrée des câbles, des ouvertures sous les armoires, des plaques perforées redondantes qui peuvent ne pas être situées dans les couloirs froids, des ouvertures dans le plancher autour de la salle informatique (derrière les unités de contrôle d’air, sous les unités de distribution d’énergie).

Une capacité de refroidissement excessive dans un centre de données peut nuire

De manière surprenante, un manque de capacité de refroidissement n’est pas l’unique cause de l’apparition de points chauds. Une capacité de refroidissement excessive peut entraîner des points chauds. Comment cela peut-il arriver ?

Si 8 unités de refroidissement sont nécessaires pour refroidir la salle informatique du centre de données , et que 10 ou 12 sont installées et fonctionnent, où, bien sûr, chacune des 10 ou 12 unités fonctionnera avec moins de puissance (que lorsque seulement 8 unités de refroidissement auraient fonctionné) . Cela conduit à une diminution de l’alimentation en air et de la charge, ce qui conduit à l’apparition de zones chaudes supplémentaires dans des endroits à faible pression statique (zones mortes).

Élimination des points chauds dans le centre de données

Protocole pour la réduction des points chauds

L’élimination des points chauds dans un centre de données peut être réalisée en suivant plusieurs étapes :

1. Surveillance de la température : Utiliser des capteurs de température pour surveiller et identifier les zones chaudes dans le centre de données. Cela permettra une détection précoce des problèmes de surchauffe.

2. Agencement efficace des serveurs : Il faut s’assurer une disposition optimale des serveurs, en maximisant l’espace entre eux pour permettre une meilleure circulation de l’air. Éviter les encombrements et les obstacles qui peuvent empêcher la circulation de l’air froid.

3. Utilisation de racks de refroidissement : Utiliser des racks de refroidissement pour les serveurs qui génèrent une chaleur excessive. Ces racks peuvent dissiper la chaleur plus efficacement et permettre une meilleure circulation de l’air.

4. Utilisation de la gestion de câbles : Organiser les câbles de manière ordonnée afin qu’ils ne bloquent pas les flux d’air. Les câbles mal organisés peuvent créer des zones chaudes.

5. Optimisation de la ventilation et du flux d’air : Assurer une bonne ventilation dans le centre de données. Assurer un bon flux d’air à travers le centre de données aidera à éliminer les points chauds.

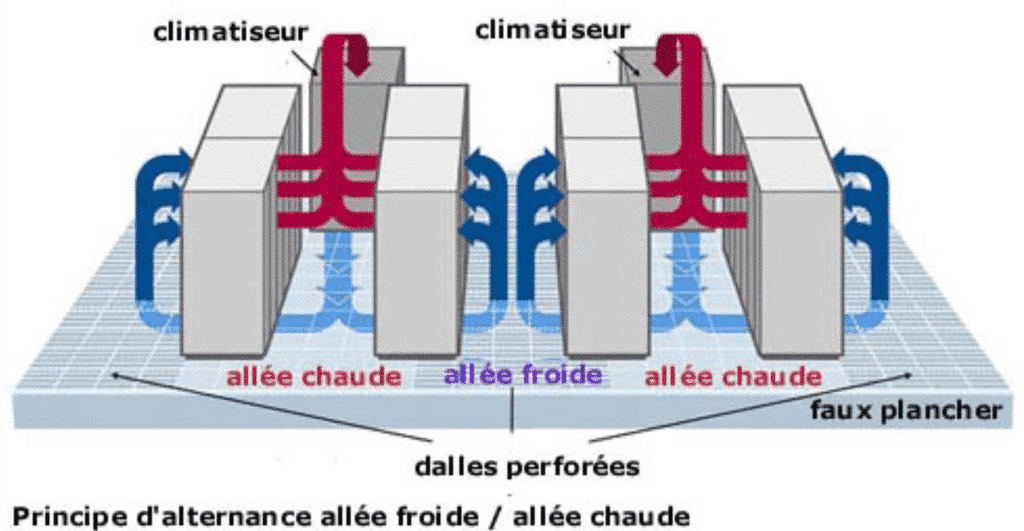

Pour s’assurer du bon brassage d’air du date center, seul le nombre requis de dalles perforées doit être installé dans les couloirs froids du centre de données . Les dalles de plancher surélevées ne doivent pas être situées dans des allées chaudes ou dans un espace inutilisé de la salle informatique. Pour calculer le nombre de dalles perforées nécessaires dans la conception d’ un centre de données , il faut se reporter aux étude CFD de dimensionnement.

L’emplacement des grilles de diffusion doit correspondre à la charge thermique de chaque armoire. Les directives générales pour le placement des dalles sont indiquées dans le tableau ci-dessous.

Mise en ouvre d'allées chaudes et d'allées froides

Les allées chaudes et froides d’un data center sont des concepts de gestion de la circulation de l’air pour maintenir une température optimale à l’intérieur du centre de données.

L’allée froide est l’espace où l’air frais est introduit dans le data center. Les équipements informatiques, tels que les serveurs, sont disposés de manière à faire face à cette allée froide, afin de capter et de bénéficier de l’air frais pour refroidir leurs composants internes.

L’allée chaude, quant à elle, est l’espace où l’air chaud est extrait du data center. Les systèmes de climatisation et de refroidissement du data center évacuent l’air chaud de cette allée en utilisant des équipements tels que les unités de refroidissement, les ventilateurs et les conduits d’évacuation de chaleur.

L’objectif de la séparation entre les allées chaude et froide est de maximiser l’efficacité du refroidissement en minimisant les mélanges entre les deux types d’air. Cela permet de réduire la consommation d’énergie nécessaire pour maintenir une température adéquate et d’améliorer les performances et la durée de vie des équipements informatiques.

Ce concept de séparation de l’air chaud et de l’air froid permet d’optimiser les coûts énergétiques du data center en minimisant les pertes d’énergie liées au mélange de l’air chaud et de l’air froid. Cela permet également de maintenir une température homogène dans le data center et de réduire les risques de surchauffe des équipements.

Pourquoi réaliser une simulation CFD d’un data center ?

La simulation CFD fournit des informations sur la relation entre le fonctionnement des systèmes mécaniques et les variations de la charge thermique des équipements informatiques. Grâce à ces informations, le personnel informatique et le personnel du site peuvent optimiser l’efficacité du flux d’air et maximiser la capacité de refroidissement.

Il est également nécessaire de sceller les armoires des équipements inutilisés. Il s’agit d’installer des panneaux obturateurs vierges pour couvrir tout espace ouvert dans le rack non occupé par l’équipement. Scellez également tous les espaces latéraux entre les rails de montage et les parois de l’armoire, les ouvertures en bas et en haut des armoires. Ne laissez pas l’air chaud recirculer de l’arrière de l’armoire vers l’avant.

Libérez un maximum d’espace sous le plancher surélevé pour une meilleure circulation de l’air. Retirez les câbles inutilisés, les débris, etc.

Pour vérifier si tout a été fait correctement, mesurez la température à l’entrée du serveur, en particulier sur les rangées supérieures des armoires de télécommunication. Cela peut être fait à l’aide de divers thermomètres : un thermomètre IR sans contact; thermomètres LCD à bande ou moniteurs de température RF sans fil. Si l’air d’admission est trop froid ou trop chaud, des plaques perforées peuvent être ajoutées, déplacées ou remplacées. Ce contrôle doit être effectué régulièrement, en particulier dans les cas où un nouvel équipement est installé ou un ancien équipement est démantelé.

Simulation de flux d’air et analyse CFD

Pour bénéficier de toutes ces mesures, il est nécessaire d’étudier attentivement la charge thermique, la capacité des équipements de refroidissement et le flux d’air dans la salle informatique du data center.

Bien entendu, des coûts supplémentaires seront engagés, mais ces coûts se justifient. Selon les statistiques d’experts impliqués dans l’optimisation du système de climatisation du centre de données, la réduction minimale de la consommation d’énergie grâce aux actions ci-dessus est de 10% à 36%.

Datas centers : sur le même sujet

Optimisation énergétique et calcul du PUE des data centers

En savoir plus

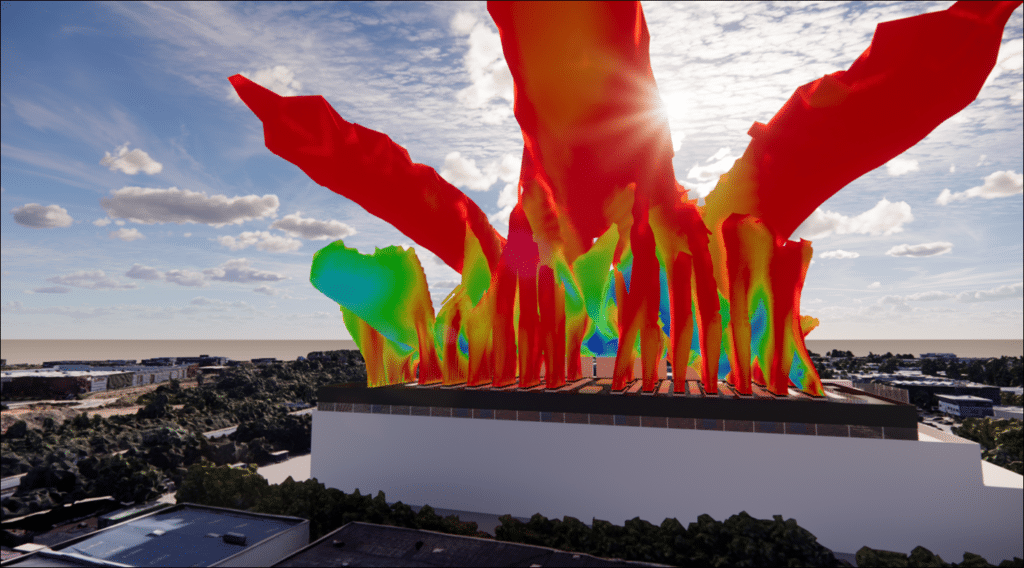

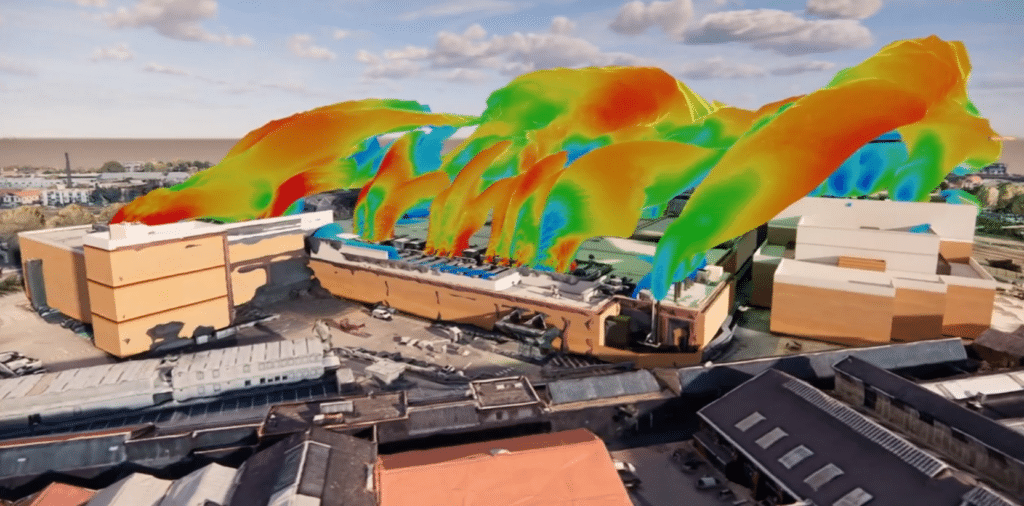

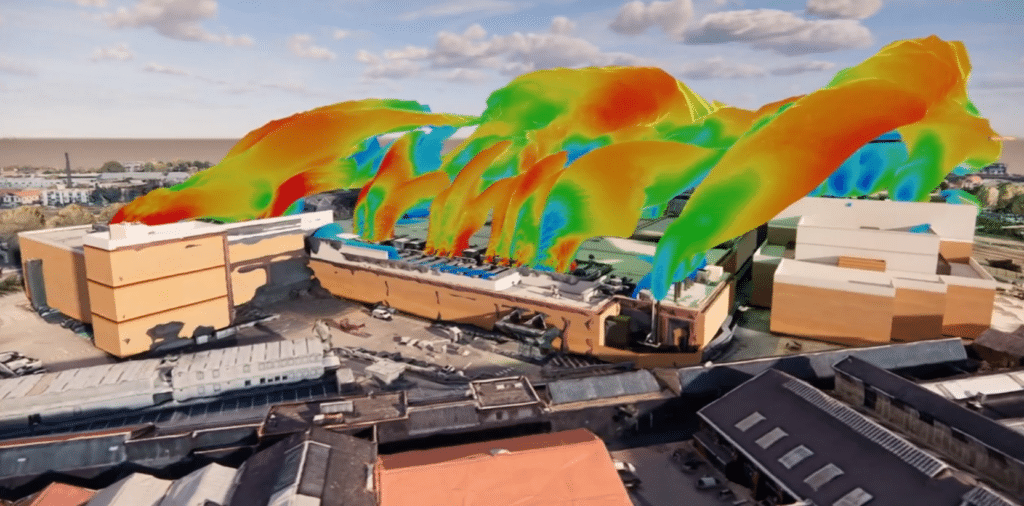

Etude d’impact d’îlot chaleur urbains des data centers

En savoir plus

Audit et Diagnostic des centres de données

En savoir plus

Bureau d’étude CFD

En savoir plus

Locaux techniques – Data Center

En savoir plus

Etude thermique des locaux Techniques

En savoir plus

Simulation Incendie Data Center

En savoir plus

Simulation CFD externe pour Data center

En savoir plus

Comprendre le fonctionnement d’un Data Center

En savoir plus